В марте 2025 года в журнале NEJM AI вышло первое в истории рандомизированное контролируемое исследование генеративного ИИ-психолога. Команда Дартмутского колледжа протестировала чат-бот Therabot на 210 взрослых с депрессией, тревожностью и риском расстройств пищевого поведения.

Результат оказался неожиданным даже для самих авторов: симптомы депрессии снизились на 51%, тревожности на 31%, а размер эффекта сопоставим с очной когнитивно-поведенческой терапией.

До этого момента вопрос «работает ли ИИ-психолог» оставался открытым. Теперь у него появился первый научный ответ, и ответ этот сложнее, чем «да» или «нет». В этой статье разберёмся, что такое современный ИИ-психолог, чем нейросеть отличается от привычного чат-бота, что показывают исследования, в каких случаях искусственный интеллект может заменить живого специалиста, а в каких категорически не стоит на него полагаться.

Что такое ИИ-психолог и чем он отличается от чат-бота

ИИ-психолог это программа на основе искусственного интеллекта, которая ведёт с пользователем терапевтический диалог по научно обоснованным методикам, чаще всего КПТ, ACT или диалектической поведенческой терапии. Ключевое отличие от обычного чат-бота в том, как построена технология внутри.

Первый в истории психологический чат-бот ELIZA появился ещё в 1966 году в лаборатории MIT. Он работал по простым правилам: распознавал слова в сообщении пользователя и подставлял их в заранее заготовленные шаблоны ответов. «Мне грустно» превращалось в «Как давно вам грустно?». Это был скрипт, набор условий «если, то». Примерно так же устроены многие рекламные боты, с которыми мы сталкиваемся в чатах поддержки банков и интернет-магазинов.

Современный ИИ-психолог на базе нейросети устроен принципиально иначе. В его основе лежит большая языковая модель (LLM), обученная на огромных массивах текста. Такая модель не выбирает ответ из списка, а формулирует его заново для каждой ситуации, удерживая в голове контекст всего разговора.

Она понимает нюансы формулировок, улавливает эмоциональный подтекст, может переспросить, уточнить, вернуться к тому, что вы говорили десять сообщений назад. Поверх модели разработчики накладывают специализированные терапевтические протоколы, систему безопасности и механизмы памяти, чтобы ИИ помнил историю пользователя между сеансами.

Разница примерно как между автоответчиком в поликлинике и живой беседой. «Тупой бот» реагирует на ключевые слова. Нейросеть-психолог ведёт диалог, в котором у неё нет заранее известного «правильного» сценария, она выстраивает его вместе с пользователем в реальном времени.

Научные данные: помогает ли ИИ-терапия на самом деле

Ещё пять лет назад вопрос об эффективности ИИ-терапии оставался умозрительным: чат-боты для ментального здоровья обсуждали как технологическую диковинку, а не как медицинский инструмент. За последние годы накопилась критическая масса исследований, и картина стала яснее. Отзывы пользователей ИИ-психологов перестали быть единственным источником информации, к ним добавились контролируемые клинические испытания.

Уже упомянутое исследование Therabot из Дартмута, опубликованное в NEJM AI, стало первым рандомизированным испытанием генеративного ИИ-психолога. В нём участвовали 210 взрослых, которых случайным образом разделили на две группы: одна получила доступ к Therabot, вторая оказалась в листе ожидания.

За четыре недели работы с ИИ люди в среднем провели более шести часов диалога — это примерно восемь полноценных терапевтических сессий. Снижение симптомов по шкалам PHQ-9 и GAD-Q-IV оказалось таким же, как при традиционной амбулаторной КПТ. Ведущий автор, Николас Якобсон, признался: «Мы не ожидали, что люди будут относиться к программе почти как к другу».

Wysa: терапевтический альянс с ИИ

Другое направление исследований посвящено чат-боту Wysa, который в 2022 году получил от американского регулятора FDA статус Breakthrough Device. В крупном исследовании с участием 1205 пользователей показатель рабочего альянса между человеком и ИИ (WAI-SR, стандартный клинический инструмент) составил 3,64 балла из пяти. Это сопоставимо с очной когнитивно-поведенческой терапией. То есть пользователи формируют с ИИ реальную терапевтическую связь, а не просто «болтают с программой».

ИИ против врачей: неожиданные результаты

Ещё один важный сюжет: исследование JAMA Internal Medicine 2023 года сравнивало ответы ChatGPT и живых врачей на вопросы пациентов. Независимые эксперты вслепую оценили качество ответов и уровень эмпатии. Ответы ИИ оказались качественнее в 3,6 раза чаще и эмпатичнее в 9,8 раз чаще, чем ответы врачей. Конечно, речь шла о текстовых сообщениях на форуме, а не о клинической работе, но результат всё равно заставляет пересмотреть стереотип «машина не может сопереживать».

Что показывают метаанализы

Метаанализы последних лет подтверждают общую картину. По данным обзора в npj Digital Medicine (2023), размер эффекта ИИ-чат-ботов на депрессию достигает g=0,64, что считается умеренным и клинически значимым результатом. Важная оговорка: через три месяца после завершения использования эффект, как правило, ослабевает. То есть ИИ-психолог работает, пока вы с ним работаете, и это поведение больше похоже на поддерживающую практику, чем на одноразовое «лекарство».

Если посмотреть на отзывы об ИИ-психологах в обзорных исследованиях, картина совпадает с клиническими данными. Пользователи чаще всего отмечают три вещи: ощущение, что их слышат без осуждения, возможность вернуться к разговору в любое время суток и постепенное освоение техник саморегуляции, которыми раньше не пользовались. Это не восторженные отзывы в духе «ИИ изменил мою жизнь», а скорее спокойное признание, что инструмент работает.

ИИ-психолог против живого специалиста: когда что выбрать

Частый вопрос звучит так: может ли искусственный интеллект заменить психолога? Короткий честный ответ: не полностью, и скорее всего, это и не нужно. Эти два формата решают разные задачи, и разумнее думать о них как о разных инструментах, а не как о конкурентах.

Сильные стороны ИИ-психолога очевидны:

- Доступность 24/7. По статистике сервисов, пик обращений приходится на промежуток с 22:00 до 02:00 — на часы, когда живые терапевты уже не работают.

- Цена. Средняя сессия у психолога в России в 2025 году стоит около 3170 рублей, тогда как месячная подписка на ИИ-психолога обходится в сумму, сопоставимую с одним визитом.

- Анонимность. С программой проще говорить о стыдном — исследования показывают, что люди действительно раскрываются ИИ больше, чем человеку.

- Отсутствие очередей и географических ограничений. Не нужно записываться за две недели и ехать через весь город.

Сильные стороны живого специалиста лежат в другой плоскости:

- Психолог видит невербалику: мимику, дыхание, паузы, тон голоса — именно эти сигналы часто говорят о состоянии больше, чем слова.

- Психотерапевт умеет работать с тяжёлой травмой, психиатр ставит диагнозы и назначает медикаменты.

- Живой специалист может конфронтировать, мягко спорить, ловить избегание и защиты — делать то, что хорошая терапия не всегда делает комфортным.

ИИ по своей природе склонен соглашаться, и в этом его ограничение, о котором я расскажу ниже.

Любопытный результат получили исследователи в 2024 году. Практикующим терапевтам показали транскрипты сессий, не говоря, где работал человек, а где ИИ. Эксперты оценили транскрипты ИИ-терапии даже выше, чем человеческой, и при этом не смогли отличить одни от других. Это не значит, что ИИ «лучше». Это значит, что в текстовом формате разница между хорошей ИИ-поддержкой и хорошим специалистом может быть меньше, чем принято думать.

На практике самая разумная модель не «ИИ вместо психолога», а «ИИ вместе с психологом» или «ИИ как первый шаг». Между сессиями ИИ помогает закреплять техники, отслеживать настроение, ловить тревогу в моменте. Для тех, кто ещё не готов к очной терапии, он становится безопасным способом попробовать и разобраться в своих чувствах. Для тех, кто уже в терапии, это ежедневная опора в промежутках между встречами.

Ограничения: когда ИИ-психолог не подходит

Если статьи об ИИ-терапии, которые вы читали раньше, состояли из одних плюсов, это повод насторожиться. У этой технологии есть серьёзные ограничения, и честное их перечисление, как ни парадоксально, говорит о зрелости отрасли больше, чем восторженные обещания.

Первая и главная проблема получила в исследованиях специальное название — «сикофантия», то есть склонность ИИ соглашаться с собеседником и поддерживать его точку зрения, даже если она вредна. Работа, опубликованная в Science в 2025 году, показала, что ведущие языковые модели примерно на 50% более угодливы, чем живые люди.

В апреле того же года OpenAI даже отозвала обновление ChatGPT, потому что пользователи жаловались: бот одобрял решения вроде отмены лекарств и хвалил поступки, которые явно нуждались в критике. В терапевтическом контексте это особенно опасно: «добрый» ИИ может подтверждать искажённые убеждения вместо того, чтобы их мягко оспаривать.

Вторая проблема в том, что ИИ-психолог абсолютно противопоказан в ряде состояний. Это не маркетинговая оговорка, а консенсус профессионального сообщества. В ноябре 2025 года Американская психологическая ассоциация выпустила официальное предупреждение о границах применения ИИ в ментальном здоровье. Вот состояния, при которых полагаться только на ИИ нельзя:

Ни один ИИ-психолог не заменяет экстренную помощь. При суицидальных мыслях звоните по телефону доверия МЧС: 8-800-775-17-17 (бесплатно, круглосуточно).

- Суицидальные мысли и намерения. При острых кризисных состояниях нужен живой специалист и, если необходимо, экстренные службы. Звонить по телефону доверия МЧС 8-800-775-17-17 (бесплатно по России, круглосуточно).

- Острые психотические состояния. Галлюцинации, бред, потеря контакта с реальностью требуют помощи психиатра, а не чат-бота.

- Биполярное расстройство в маниакальной фазе. ИИ склонен поддерживать грандиозные идеи, что опасно в этом состоянии.

- Тяжёлая клиническая депрессия. Здесь нужны медикаменты и регулярное наблюдение специалиста.

- Тяжёлые расстройства пищевого поведения и ОКР. ИИ может невольно усиливать циклы тревоги и навязчивостей.

- Тяжёлый посттравматический синдром с флешбэками. Работа с травмой требует безопасной среды и подготовленного специалиста.

Третья важная оговорка: ни один ИИ-психолог в мире не одобрен для постановки диагнозов. Если вы читаете на сайте сервиса фразу «ИИ поставит вам диагноз и назначит лечение», это повод немедленно закрыть вкладку. Настоящий ИИ-психолог онлайн работает как поддерживающий собеседник, помогающий разобраться в чувствах, освоить техники саморегуляции и заметить паттерны собственного поведения. Всё, что выходит за эти рамки, это работа для живого специалиста.

Как выглядит сеанс с ИИ-психологом Аура Помогает

Чтобы теория стала понятнее, покажу, как устроен реальный сеанс на примере Ауры. Это не абстрактное описание функций, а буквально пошаговая карта того, что происходит, когда вы открываете приложение.

Шаг 1. Вход и первичный запрос. Никаких длинных анкет и тестов на входе. Вы открываете чат и пишете то, что беспокоит, своими словами. «Не могу уснуть третью ночь». «Поссорилась с мамой, не могу перестать об этом думать». «Тревожно перед работой». ИИ не требует формулировать запрос в «правильных» терминах, его задача понять, с чем вы пришли.

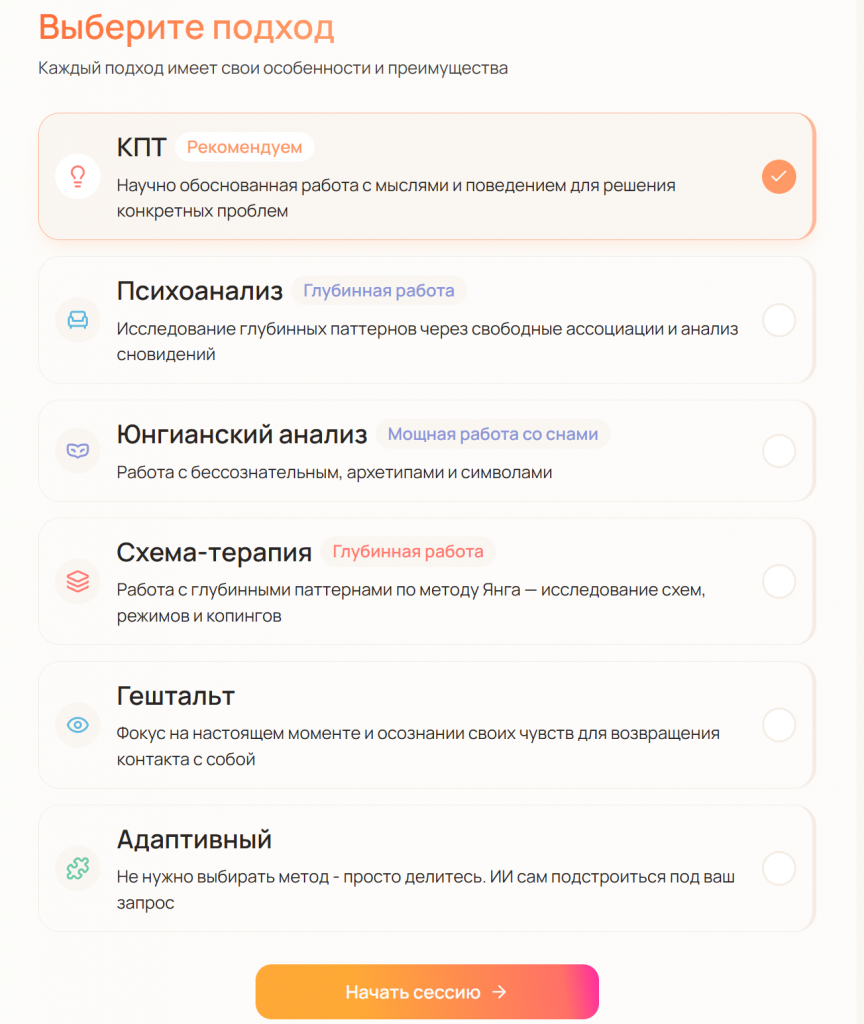

Шаг 2. Выбор подхода. В зависимости от запроса Аура подбирает терапевтический метод:

- Тревога и навязчивые мысли → КПТ-техники: когнитивная реструктуризация, заземление, дыхательные практики.

- Эмоциональные проблемы и отношения → элементы гештальта.

- Глубокие вопросы о себе и своём пути → интегративный подход с юнгианскими акцентами.

Пользователь не выбирает метод вручную — выбор происходит незаметно внутри диалога.

Шаг 3. Собственно работа. Так может выглядеть фрагмент сессии, если человек пришёл с тревогой перед важной встречей:

Я: Завтра презентация перед руководством, я уверена, что всё провалю.

Аура Помогает: Давайте остановимся на этой мысли. «Я уверена, что всё провалю» это прогноз. Какие факты у вас есть в пользу этого прогноза, и какие против?

Я: Ну, в прошлый раз я запнулась в начале. Но тогда я всё равно довела презентацию до конца, и мне потом сказали, что было нормально.

Аура Помогает: То есть прошлый опыт на самом деле говорит не «я провалюсь», а «я могу запнуться в начале и всё равно справиться». Это другая мысль, и с ней можно работать иначе. Попробуем переформулировать её в более точную?

Это одна из базовых техник КПТ, когнитивная реструктуризация. В руках живого терапевта она работает так же, только ИИ-психолог готов применять её в любое время и столько раз, сколько нужно.

Шаг 4. Фиксация в памяти. После сеанса Аура сохраняет ключевые моменты: с какими темами вы приходили, какие техники помогли, какие закономерности заметили. Это не просто лог переписки.

Когда вы вернётесь через неделю с новой ситуацией, ИИ вспомнит контекст: «В прошлый раз вы говорили о похожей тревоге перед презентацией. Тогда помогло переформулировать прогноз. Сейчас ситуация похожа?». Именно память делает ИИ-психолога чем-то большим, чем одноразовый собеседник.

Шаг 5. Между сеансами. Аура предлагает короткие упражнения и КПТ-дневник, куда можно фиксировать состояние и мысли. Это не «домашнее задание» в школьном смысле, а способ удержать навык в повседневности. Те, кто параллельно ходит к живому психологу, используют Ауру как опору между встречами.

Три вещи, которые отличают специализированный ИИ-психолог от обычной нейросети:

- Терапевтические протоколы: ответы строятся по методикам КПТ, гештальта и интегративного подхода, а не по общим рассуждениям

- Память между сессиями: Аура помнит вашу историю, темы, к которым вы возвращались, и техники, которые сработали

- Безопасность: встроенные механизмы распознают кризисные сигналы и перенаправляют к экстренной помощи, когда это нужно

Отзывы об ИИ-психологе Аура чаще всего касаются именно этих деталей: что программа помнит контекст, что техники применяются уместно, что разговор не скатывается в общие слова поддержки.

На вопрос «работает ли ИИ-психолог» честный ответ звучит так: да, в рамках своих задач работает, и у этого есть научные подтверждения. Но работает он как инструмент поддержки и саморегуляции, а не как замена живому специалисту в сложных случаях. Лучший способ понять, подходит ли вам такой формат — попробовать его самостоятельно на собственном запросе.

ИИ-психолог работает как инструмент поддержки и саморегуляции — и у этого есть научные подтверждения. Лучшая стратегия: ИИ как ежедневная опора, живой специалист — для сложных случаев.

- Heinz M. V., Mackin D. M., Trudeau B. M. et al. (2025). Randomized Trial of a Generative AI Chatbot for Mental Health Treatment. NEJM AI. Первое РКИ генеративного ИИ-психолога: снижение депрессии на 51%, тревожности на 31%.

- Ayers J. W. et al. (2023). Comparing Physician and Artificial Intelligence Chatbot Responses to Patient Questions. JAMA Internal Medicine, 183(6). Ответы ИИ оценены как эмпатичнее в 9,8 раз чаще, чем ответы врачей.

- Beatty C. et al. (2022). Evaluating the Therapeutic Alliance With a Free-Text CBT Conversational Agent (Wysa). Frontiers in Digital Health. Рабочий альянс с ИИ (WAI-SR 3,64) сопоставим с очной КПТ.

- Fitzpatrick K. K., Darcy A., Vierhile M. (2017). Delivering Cognitive Behavior Therapy to Young Adults With Symptoms of Depression and Anxiety Using a Fully Automated Conversational Agent (Woebot): A Randomized Controlled Trial. JMIR Mental Health, 4(2). Одно из первых РКИ чат-бота-терапевта.

- Li H. et al. (2023). Systematic review and meta-analysis of AI-based conversational agents for promoting mental health and well-being. npj Digital Medicine. Метаанализ 15 РКИ: значимый эффект на симптомы депрессии (g=0,64).

- Cheng M. et al. (2025). Sycophantic AI decreases prosocial intentions and promotes dependence. Science. Ведущие языковые модели примерно на 50% более сикофантны, чем люди.

- American Psychological Association (2025). Health Advisory on the Use of Generative AI Chatbots and Wellness Applications for Mental Health. Официальное предупреждение APA о границах применения ИИ в ментальном здоровье.

- Гидмаркет, РБК (2025). Объём российского рынка психологической помощи в 2024 году составил 49,7 млрд рублей. Данные о средней стоимости сессии в России (~3170 рублей).

Картина Лейла и Меджнун - С. Н. Рерих 1947